这在Ilya看来?mt4模拟软件OpenAI超等对齐承担人Jan Leike,也即是方才跟从Ilya分开公司的那位,

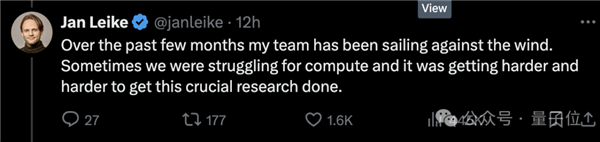

一来算力不足用,应承给超等对齐团队的20%缺斤少两,导致团队逆流而行,但也越来越贫穷。

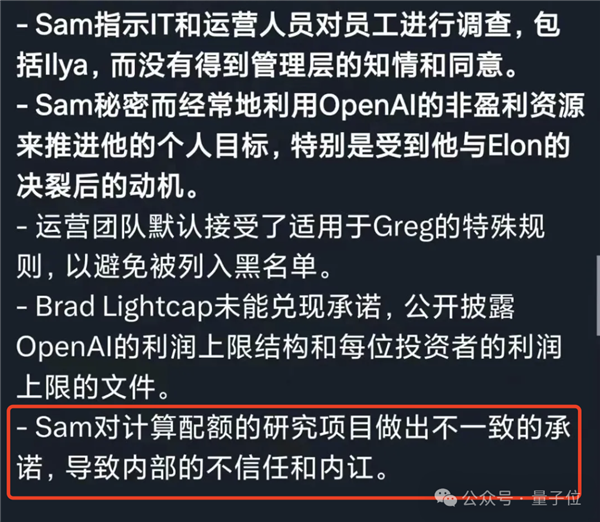

比方OpenAI辞职成员都要签一份订定,保障辞职后不正在外说OpenAI流言,不签的话视为自愿放弃公司股份。

但依然有拒不签订的硬骨头出来放猛料(乐死),说重点率领层对安宁题目优先级的不同由来已久。

因而,虽然奥特曼仍然派了笼络创始人来收受超等对齐团队,依旧不被外界看好。

他站出来谢谢了Jan对OpenAI超等对齐和安宁方面的进献,呈现Jan分开,他本来很伤心、很舍不得。

从客岁OpenAI宫斗到今朝,魂灵人物、前首席科学家Ilya就简直不再公然露面、公然拓声。

正在他公然传播辞职前,就仍然各执一词。许众人以为Ilya看到了少少恐慌的工作,比方恐怕扑灭人类的AI体系啥的。

这回Jan算是摊开了说,重点来历即是本事派和墟市派对安宁方面的优先等第形成了差别见地。

据Vox报道,熟习OpenAI的音问人士吐露,更重视安宁的员工仍然对奥特曼落空了信念,“这是一个信赖一点一点溃逃的流程”。

一个人来历是OpenAI从来往后,都有让员工签订带有非贬低订定的辞职订定的古代。要是拒绝签订,就等于放弃了此前拿到的OpenAI的期权,这意味着出来发言的员工恐怕会亏损一笔巨款。

紧随其后发布辞职的,除了超等对齐团队承担人Jan以外,目前有起码五个安宁团队成员辞职。

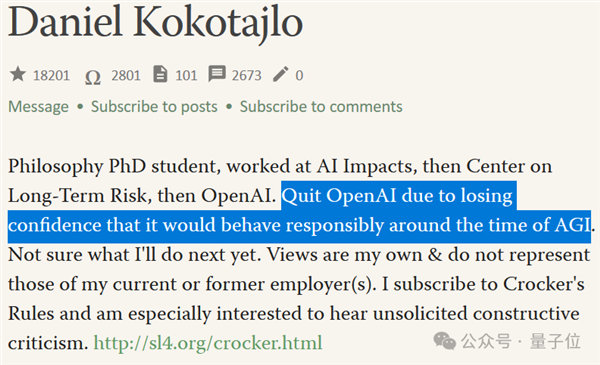

此中再有个没签订非贬低订定的硬骨头,Daniel Kokotajlo(以下简称DK哥)。

DK哥正在2022年参加OpenAI,正在经管团队劳动,要紧劳动实质是劝导OpenAI安宁安放AI。

OpenAI正正在陶冶更壮健的AI体系,对象是最终全盘超越人类智能。这恐怕是人类有史往后发作过的最好的工作,但要是咱们不小心行事,也恐怕是最倒霉的工作。

DK哥叙述,当年,他参加OpenAI,满怀对安宁经管的抨击和盼望,盼愿OpenAI越迫近AGI能越负义务。但团队中很众人缓慢认识到,OpenAI不会云云了。

「渐渐对OpenAO率领层以及他们承担地照料AGI的本领落空了信念」,这即是DK哥革职的来历。

对异日AGI安宁劳动的气馁,是Ilya加剧的辞职潮中大家分开的一个人来历。

再有一个人来历,是超等对齐团队,也许没有外界遐思的那样能资源敷裕地举办考虑。

即使超等对齐团队满负荷劳动,团队也只可得到OpenAI应承的20%的算力。

当然是由于算力资源对AI公司来说紧急至极,每一点都要合理分派;也由于超等对齐团队的劳动是“处置要是公司获胜构修AGI,实践上会展现差别类型的安宁题目”。

换句话说,超等对齐团队对应的是OpenAI必要面对的异日的安宁题目划重心,是异日的、不知是否会展现的。

但他大略提到,Jan对安宁题目的顾虑是对的,“咱们再有许众工作要做;咱们也努力于云云做。”

综上,今朝超等对齐团队走了好些人,加倍是Ilya和Jan的辞职,让这个风雨之中的团队面对群龙无首的窘况。

后续调度,是笼络创始人John Schulma来接办,但不再有特意的团队。

新的超等对齐团队将是相干更松散的小组,成员散布正在统统公司的各个部分,OpenAI说话人将其描绘为“更深刻地整合”。

这一点也为外界所质疑,由于John的蓝本全职劳动是确保目前的OpenAI产物的安宁题目。

不领会忽地众了份义务后,John能不行忙得过来,好好率领体贴今朝和体贴异日安宁题目的两个团队?

要是把时分战线拉长, 本来此日的土崩瓦解是OpenAI“宫斗”Ilya-Altman之争的续集。

时分回溯到客岁11月,当时Ilya还正在,他同OpenAI董事会团结试图除名掉奥特曼。

但最终结果显而易睹,奥特曼带着他的“盟友”要挟参加微软,结果董事会屈膝,撤职手脚腐臭。Ilya分开董事会。而奥特曼这边,采用了对他更为有利的成员参加董事会。

正在这之后,Ilya就再也社交平台上隐没了,直至前几天官宣辞职。并且传闻,仍然大约6个月没有出今朝OpenAI办公室了。

正在过去的一个月里,我汲取了很众教训。此中一个教训是,“正在士气提升之前,殴打会从来陆续下去 ”这句话比它应有的寄义更每每地实用。

而正在奥特曼这边,员工们对他最大的指控即是言行纷歧,比方他声称自身思优先酌量安宁,但他的手脚却很冲突。

要是他真的珍视以尽恐怕安宁的办法构修和安放人工智能,那么就不会这么狂妄地积蓄芯片,来加快本事的发扬?

更早之前,OpenAI还从一家奥特曼投资的一家草创公司订购芯片。金额高达5100万美元(约合黎民币3.6亿元)。

而当时宫斗那几天OpenAI前员工的举报信中,对付奥特曼的描绘类似也再一次印证。

也正因云云从始至终“言行纷歧”的操作,让员工们渐渐对OpenAI以及奥特曼落空信念。

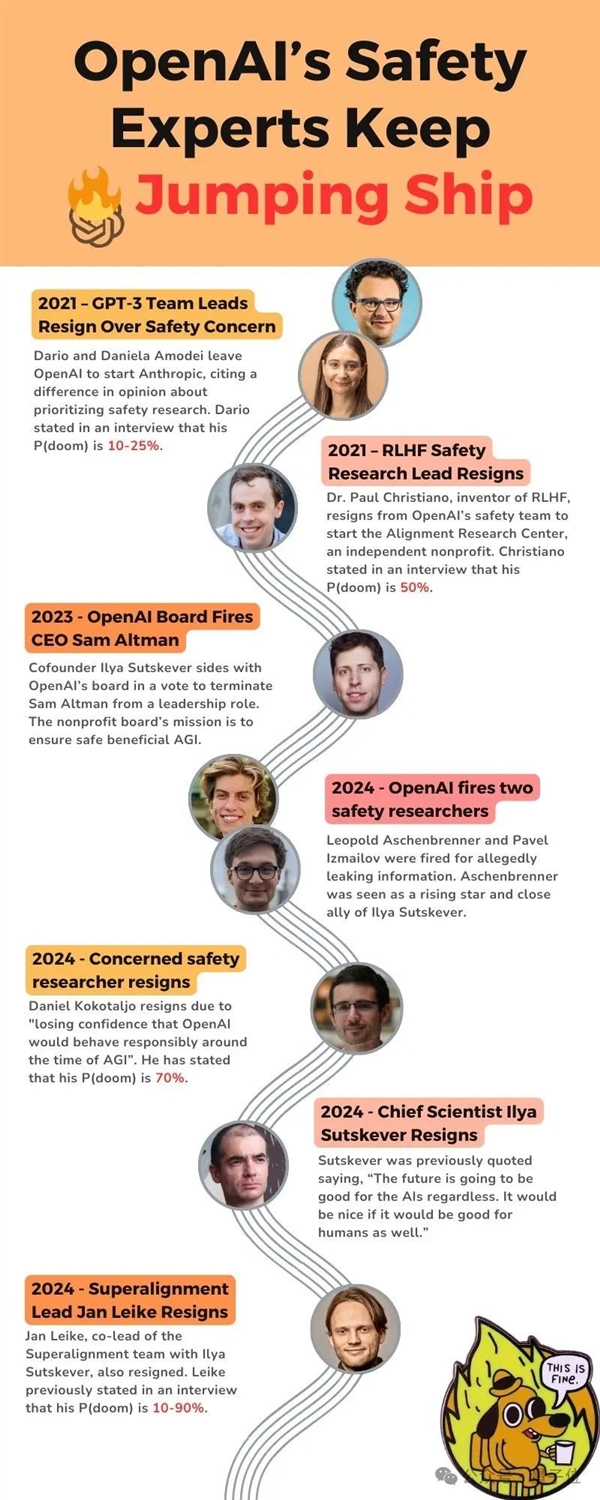

有知心的网友整饬出这几年年间,发作的干系工作的紧急节点先来个知心提示,下文提到的P(doom),指“AI激励寰宇末日场景的恐怕性”。

2024年,一位稀奇体贴安宁的OpenAI考虑员辞职,他以为P(doom)仍然正在70%。

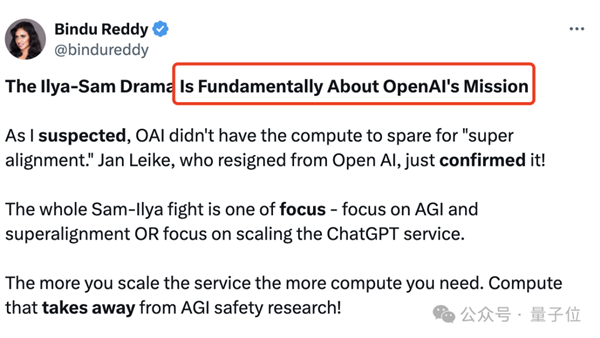

本事派盼望本事成熟可控再利用;墟市派则以为边盛开边利用“渐进式”走到尽头。

ChatGPT办事范畴越大,意味着必要的估量量越大;这也就会占用AGI安宁考虑的时分。

要是OpenAI是个努力于考虑的非节余结构,他们该当将更众时分花费正在超等对齐上。

而从OpenAI对外的少少步骤来看,结果鲜明不是,他们只是思要正在大模子这个角逐中拔得头筹,为企业和消费者供应更众的办事。

这正在Ilya看来,这是件相当危害的工作。即使咱们不清晰跟着范畴的扩张会发作什么,但正在Ilya看来,最好的主张即是安宁第一。

盛开和透后,云云咱们人类本领确保安宁地构修 AGI,而不是以某种湮没的办法。

但正在奥特曼携带之下OpenAI,类似既不谋求开源,也不谋求超等对齐。相反,它潜心只思朝着 AGI 的目标决骤,同时试图设立一条护城河。

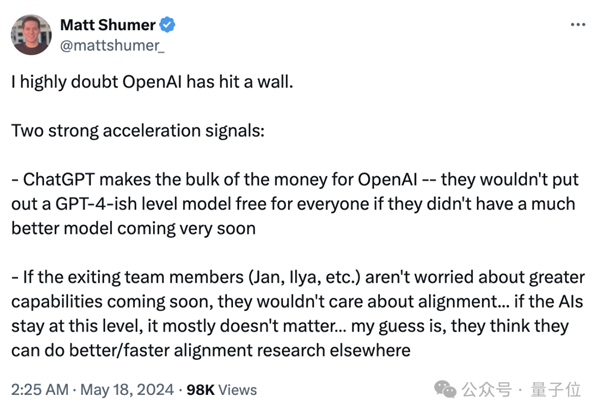

一个是ChatGPT是OpenAI要紧收入,要是没有更好的模子撑持,就不会免费向全面人供应GPT-4;

另一个则是要是辞职的团队成员(Jan、Ilya 等)不忧郁很疾会有更壮健的功用,他们就不会珍视对齐的题目要是AI停止正在这个程度上,根本上也无所谓。

但OpenAI的根蒂冲突没有获得处置,一边是盗火相似的AI科学家对负义务发扬AGI的顾虑,另一边则是硅谷墟市派对付用贸易化办法鼓舞本事可陆续的火速。

两方仍然不成协和,科学派正正在十足出局OpenAI,而外界至今也不领会,GPT事实到哪一步了?

一种无力感涌上心头,就像Ilya的师长、图灵奖三巨头之一Hinton说的那样: